社内の生成AI利用を巡り、経営層からは「情報漏洩リスクを抑えたい」、現場からは「AI禁止では業務効率が落ちる」という圧力を同時に受けていないでしょうか。CASBやZscaler、Netskopeでアクセスを可視化しブロックすることは推奨されていますが、それだけではシャドーAIやシャドーITは止まらず、従業員は私物端末や外部ネットワークという抜け道に流れます。結果として、セキュリティリスクだけが高くなり、ツール投資は「アラート地獄」と形骸化したダッシュボードに姿を変えます。

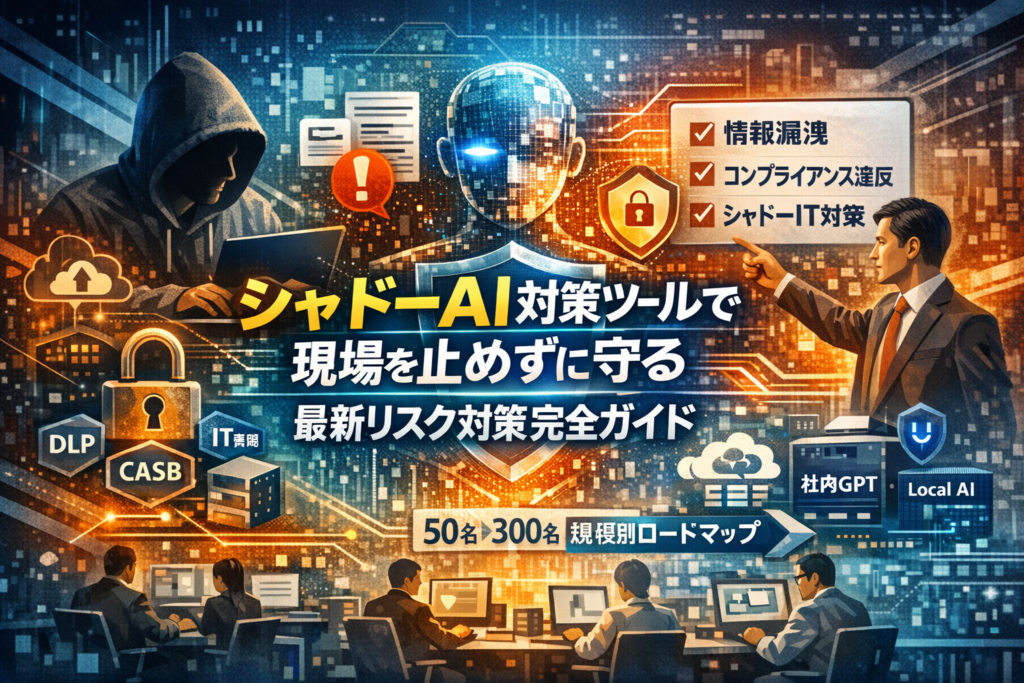

本記事では、シャドーAI対策ツールをCASB DLP Webフィルタリング IT資産管理 ローカルAI/社内GPTといったレイヤーで整理し、「どの業務にどの制御をかけるか」「自社の規模と成熟度でどこまでをツールで、どこからをガイドラインと教育で担保するか」を具体的に設計します。さらに、営業やマーケが現場で実際に起こしている生成AIへの危険なコピペ入力パターン、AI利用ポリシーの中身、従業員教育の現実解、従業員50名/300名超といった規模別ロードマップまで一気通貫で解説します。

AI活用を止めずにセキュリティリスクとコンプライアンス違反を抑えたい情報システム部門マネージャーにとって、本記事は「どのツールをどう組み合わせ、どこから着手すべきか」が即決できる実務ガイドになります。

目次

シャドーAI対策ツールはいつどこから生まれるのか?現場で本当に起きている驚きの使われ方

気付いたら、営業フロアの半分がChatGPTを開きっぱなしにしている。

禁止もしていないのに、承認もしていない使い方が広がっている。

その瞬間から、シャドーAIと呼ばれる“見えないAI利用”が静かに動き始めます。

IT部門やマネージャーが見落としがちなのは、シャドーAIは「ある日突然」ではなく「今日のちょっとしたコピペ」から始まる点です。

営業やマーケが陥りがちな生成AIへのコピペ入力パターン4選とその危険な漏洩リスク

現場でよく見るパターンを、リスクのポイントと一緒に整理します。

-

提案書・見積書の丸ごとコピペ

顧客名や金額、取引条件まで含めてAIに投げ、言い回しだけ整えてもらうケースです。

NDA情報や機密条件がそのまま外部サービスに渡ります。 -

営業日報・クレーム内容の要約依頼

個人名、社名、具体的なトラブル内容を含めたまま要約させるケースです。

個人情報保護だけでなく、ブランド毀損につながる情報が蓄積されます。 -

マーケターによる顧客リストのセグメント指示

CSVのメールアドレスや行動履歴を貼り付けて、「開封率を上げるセグメント案を出して」と頼むケースです。

CRMから持ち出したデータが、そのまま第三者提供に相当する扱いになりかねません。 -

競合調査レポートのドラフト作成

社内でしか共有していない戦略資料や原価情報をプロンプトとして渡すケースです。

競争力の源泉となるデータが、どこの国のどのサーバーで処理されているかも分からない状態になります。

この4つに共通するのは、「文章として整っている情報ほど、危険な密度でデータが詰まっている」ことです。コピー1回で、機密情報・個人情報・NDA情報が一気に移送されます。

シャドーAIとシャドーITの違いを業務現場でかんたん切り分け解説

現場で混同されやすい2つを、感覚的に区別できるようにまとめます。

| 観点 | シャドーAI | シャドーIT |

|---|---|---|

| 主な対象 | 生成AIサービスやチャットボット | クラウドストレージやSaaS、無断アプリ |

| 利用者の意図 | 業務効率アップ・文章作成・分析補助 | ファイル共有・タスク管理・コミュニケーション |

| 情報の流れ | プロンプトとして機密を「入力」しがち | データを「保存・共有」しがち |

| 発見の難しさ | ブラウザ利用履歴だけでは中身が見えない | アカウント・アプリ名で検知しやすい |

IT部門が従来のシャドーIT対策だけをしていると、「どのAIに、どんな中身を入れているか」が完全に死角になります。

ツールの利用可否だけでなく、プロンプト内容という“中身のリスク”を別レイヤーで見る必要がある点が、シャドーAIの厄介さです。

AI禁止が抜け道探しを招き新たなシャドーITを呼ぶ本当の理由

「もう面倒だからAI全面禁止」と打ち出した組織ほど、半年後にシャドーITが増えているケースがあります。理由はシンプルです。

-

営業やマーケ担当は、競合企業がAIで効率を上げていることを肌で感じている

-

禁止された結果、自宅PCや個人スマホ経由でAIを使い始める

-

私物ストレージや無料SaaSと組み合わせて、会社の目が届かない“第二の業務環境”を作り出す

この流れになると、情報システム部門はログも取れず、どのデータがどこへ行ったか追えない状態に陥ります。

本来やるべきなのは、

-

どの業務でAI活用を許可するかを整理する

-

禁止情報と許可ツールを明確にする

-

その上で、CASBやWebフィルタリングで“許可されたAIだけ”を通す

という、「禁止」ではなく「管理された解禁」です。

Webマーケ支援とAI活用を日常的に行っている私の視点で言いますと、AIを止める企業より、最初からガイドラインと監視をセットで整えた企業の方が、売上とセキュリティの両面で成果が出ています。

次の章以降では、その前提となるリスク分類やツール選定の設計図を具体的に掘り下げていきます。

企業を激震させるシャドーAIリスク5分類を一挙解説 情報漏洩からブランド毀損の全容

機密情報や個人情報・NDA情報がAIに吸い込まれる流出メカニズムを暴く

営業資料や顧客データをそのまま生成AIに入力すると、クラウド側でログ化・学習・運営担当者のアクセスといった経路で第三者に触れられる可能性が生まれます。

API接続やブラウザ拡張機能経由の自動送信も見落とされがちで、従業員が意図せず機密やNDA対象情報を継続的にアップロードしてしまう構造がシャドーAIの本質です。

コンプライアンス違反やAIハルシネーションが炎上・取引停止に直結するリアルシナリオ

生成AIがそれらしく作った誤情報を、法務チェックなしで提案書やブログに掲載すると、著作権侵害や景品表示法違反につながります。

ChatGPTで作った文章をそのまま広告に使い、誤った数値や根拠不明な表現が発覚して、取引先から「コンプライアンス体制を疑う」と契約見直しを迫られるケースは珍しくありません。

運用・監査・ガバナンス面でひそかに潜む“見えない管理リスク“を見逃さない方法

最大の落とし穴は、AI利用ログが「どこにも残っていない」状態です。

誰が・いつ・どのサービスに・どの業務データを入力したかを追跡できなければ、事故後の原因特定も再発防止策も立ちません。

最低限、プロキシやWebフィルタリング、IT資産管理ツールでアクセス状況を記録し、「管理している」という証拠を残すことがガバナンスの土台になります。

シャドーAI対策ツールの全体マップ CASB・DLP・IT資産管理やWebフィルタリングの役割丸わかり

CASBとZscalerやNetskopeが実は頼れる領域とカバー外エリアを徹底比較

CASBやZscaler、Netskopeはクラウドサービスへの通信を可視化し、未承認AIサービスをブロックするのが得意です。

一方で、ローカルアプリや私物端末からの利用まではカバーしきれないため、エンドポイント側の対策と組み合わせる前提で設計する必要があります。

シャドーIT対策ツール(IT資産管理やエンドポイント管理)で「誰が何を使っているか」を見える化

LANSCOPEやMOTEX系のIT資産管理、エンドポイント管理ツールは、端末にインストールされたアプリやWebアクセス履歴を一覧化できます。

どの部門の従業員が、どのAIサービスやクラウドにどれだけ依存しているのかを把握し、承認・禁止の線引きをするための「現状把握レーダー」として機能します。

Webフィルタリングやプロキシ・DLPを使うことで「どのAIへ何を漏らさないか」をコントロール

Webフィルタリングやプロキシは、生成AIサイトそのもののアクセス制御に向いています。

DLPは画面コピーやファイルアップロード時に機密情報を検知し、送信前にブロック・警告を出せます。

URL単位の禁止だけでなく、「顧客名や個人番号を含むデータは外部AIに送らせない」といった精度の高い制御が可能です。

ローカルAIや社内GPTを安全な代替案として用意する意味を解説

外部サービスをすべて禁止すると、従業員は自宅PCや個人スマホで抜け道を探します。

ローカルAIや社内GPT、国内データセンター限定のサービスを用意し、「ここにだけ業務データを入力してよい」という安全な逃げ場を先に提示する方が、シャドーAIを減らしやすくなります。

AI禁止ではなく管理された解禁を!利用ポリシーとガバナンス体制の実践設計図

AI利用ポリシーで必ず盛り込むべき5つの軸(目的・対象業務・入力禁止情報・許可ツールや責任)

AI利用ポリシーでは、

- 利用目的

- 対象業務

- 入力禁止情報(個人情報・機密・NDA・攻撃コードなど)

- 許可ツール一覧と承認プロセス

- 最終責任(成果物のチェック責任者)

を明文化します。これがないと、ツールだけ強化しても判断基準が現場に伝わりません。

情報システムや法務・経営・現場がしっかり噛み合うAIガバナンス構築の秘訣

情シスがセキュリティリスクを、法務がコンプライアンスを、経営が事業インパクトを、各部門マネージャーが業務効率をそれぞれ見ています。

AIガバナンスは、この4者で「何を守り、どこまで攻めるか」の優先順位を合意する場を作るところから始まります。

シャドーAIを減らすために効く従業員教育やリテラシー強化の現実的アプローチ

禁止事項の読み合わせだけでは行動は変わりません。

営業・マーケ・開発など職種別に「ありがちな危険入力例」と「安全なプロンプト例」を提示し、短時間のハンズオン研修で体験させる方が定着します。

私の視点で言いますと、年1回のeラーニングより、月1回の10分共有の方がシャドーAI抑止には効果的でした。

規模別シャドーAI対策ツール導入ロードマップ 中小からエンタープライズまで無理なく進めるステップ

従業員50名までの会社がまず押さえるガイドラインと簡単モニタリングセット

小規模では、高価なCASBよりもガイドライン策定とブラウザ履歴・プロキシログの簡易モニタリングが現実的です。

「外部AIに個人情報と未公開の売上データは禁止」といったシンプルなルールを、全従業員に浸透させることが先決です。

50〜300名規模で効力を発揮!IT資産管理とWebフィルタリングの最適タッグ

中堅規模になると、IT資産管理ツールとWebフィルタリングの組み合わせがコストと効果のバランスに優れます。

| 規模 | 優先ツール | 目的 |

|---|---|---|

| 〜50名 | ガイドライン+簡易ログ | 最低限の可視化 |

| 50〜300名 | IT資産管理+Webフィルタリング | 利用実態の把握とブロック |

| 300名〜 | CASB+SSE+DLP | 高度な制御と監査 |

これにより、どの部署でどのAIサービスが増えているかを数値で議論できるようになります。

300名以上で本気導入に向くCASBやSSE・DLPのポイントと落とし穴を徹底解説

大規模ではCASBやSSE、DLPが有力ですが、「とりあえず全検知・全アラート」にすると運用が破綻します。

最初は対象部門と対象サービスを絞り、監視ルールも「明らかなNGパターン」から段階的に広げる設計が欠かせません。

よくある失敗パターン3選 ツール入れすぎや“アラート地獄”を回避する打開策

「とりあえずCASB導入」が運用崩壊するまでの落とし穴

要件定義をせずに導入すると、アラートが日々数百件発生し、「誰も見ないダッシュボード」と化します。

どのAIサービスを許可し、どの部門を重点監視するかを先に決めておくことが、ツール投資を無駄にしないポイントです。

AI利用ログを取ったのに“誰も見ない誰も判断しない”を防ぐ賢い手順

ログ監視の役割を情シスだけに押し付けると、判断が止まります。

月次で法務・情シス・主要部門マネージャーが集まり、「怪しい利用トップ10」をレビューする定例会を設けると、運用が回り始めます。

ベンダー任せにせず社内に最低限必要な運用設計図を持つ方法

ALSOKやLANSCOPEなどベンダーの提案は有益ですが、「自社で決めるべき軸」を持たなければ、過剰機能を買うリスクがあります。

自社でまず整理したいのは、守るべき情報の棚卸しと、AI活用で伸ばしたい業務領域のリストです。

AI活用チーム成功と失敗の分かれ道 現場発シャドーAIとコンプライアンスのリアル

AIをたたき台利用にとどめるチームと最終成果物まで使ってしまうチームの明暗

成功しているチームは、AIを「たたき台」と割り切り、最終成果物は必ず人がレビューしています。

失敗するチームは、スピードを優先してAI生成文をそのまま顧客提案やサイト公開に使い、品質問題とブランド毀損に直結します。

コンテンツ品質やブランド価値SEO評価に効くAI活用のコツ

SEOやMEOの現場では、AIが書いた骨子を人間がリライトし、自社ならではの事例やデータを足すことで評価が安定します。

AI任せにすると、どこかで見たような内容になり、検索エンジンからもユーザーからも「代わり映えしない情報」と判断されやすくなります。

成功事例がなぜ別部署のシャドーAI増加の引き金にもなるのか?

一部部署でAI活用がうまくいくと、その噂を聞いた別部署が、ガイドライン外のサービスを勝手に試し始めることがあります。

成功事例を共有するタイミングで、「利用ルール」と「承認されたツール一覧」もセットで伝えることで、シャドーAIの拡大を抑えられます。

チェックリスト&FAQ シャドーAI対策ツール導入前に絶対クリアすべきポイント総まとめ

「AIに入力してはいけない情報」はどこまで?現実的な線引きルール

最低限、個人を特定できる情報、契約書原文、未公開の売上・原価データ、取引先名と具体的な取引条件は外部AIへの入力を禁止します。

どうしても使いたい場合は、匿名化や架空データへの置き換えを徹底します。

シャドーITを防ぐならネットワークや端末・クラウドの「ここ」を押さえよう

ネットワークではプロキシとWebフィルタリング、端末ではIT資産管理とエンドポイント監視、クラウドではCASBという三層で考えると整理しやすくなります。

どこにも監視が効いていない層があると、そこが抜け道になりやすいポイントです。

ベンダー選定で見落としがちな運用や監視体制チェック項目

導入前に、

-

誰がアラートを確認するか

-

どの頻度でログをレビューするか

-

ルール変更を誰が承認するか

を社内で決めておき、その運用フローにツールがフィットするかを確認します。

Webマーケ現場から語る“賢いリスク管理” 宇井和朗流シャドーAI対策ツール成功術

AI業務効率化と情報漏洩やブランド毀損リスクの損益分岐点を読み解く

Webマーケやコンテンツ作成の現場では、AI活用で生産性は大きく向上しますが、一度の情報漏洩や炎上で得た利益が一気に吹き飛ぶ可能性があります。

効率アップとリスク低減の両方を数値で比較し、「どこまでAIに任せるか」の線を経営レベルで決めることが重要です。

SEOやMEO・AIO支援現場で見えたAIコンテンツ運用の成功&失敗パターン

成功例は、AIで量産するのではなく、専門家の知見を補完する形で使い、検索意図に深く刺さる一次情報を積み上げています。

失敗例は、キーワードと共起語を詰め込んだだけのAI生成記事を量産し、ユーザーの信頼を失うパターンです。

シャドーAI対策ツールを単なるコストでなくWeb集客や事業成長の基盤に変える思考

適切なツールとガバナンスを整えることで、「安心してAIを使える環境」が生まれます。

その結果、従業員はリスクを恐れてAIを避けるのではなく、攻めのWebマーケや新サービス開発に集中できるようになります。

セキュリティ投資を、AI時代の事業インフラと捉え直すことが、これからの経営には欠かせません。

シャドーAI対策ツールの全体マップCASB・DLP・IT資産管理やWebフィルタリングの役割丸わかり

「とりあえずAIは禁止」で止めるか、「安全に使わせて成果を出すか」。分かれ道を決めるのが、このレイヤーマップです。ツールごとの守備範囲を整理すると、どこに投資すべきかが一気にクリアになります。

まずは全体像をざっくり押さえておきます。

| レイヤー | 主な目的 | 代表ツール・機能例 |

|---|---|---|

| ネットワーク/CASB | クラウドAIサービスへのアクセス制御 | CASB、Zscaler、Netskope |

| エンドポイント/資産 | 誰がどの端末で何を使うかの把握 | IT資産管理、エンドポイント管理 |

| Web/メール | 危険サイト遮断と送信データの制御 | Webフィルタリング、プロキシ |

| データ保護/DLP | 機密情報の持ち出し検知・ブロック | DLP、ログ監視 |

| 代替AI基盤 | 安全なAIの“正規ルート” | ローカルAI、社内GPT |

CASBとZscalerやNetskopeが実は頼れる領域とカバー外エリアを徹底比較

クラウド型AIサービスへの“入口ゲート”を握るのがCASBやSSEです。ZscalerやNetskopeは、次のような場面で力を発揮します。

-

承認していないAIサービスへのアクセスを検知・ブロック

-

部門ごとに「使ってよいAI」「読取のみOK」などの細かな制御

-

AIサービスへのPOSTデータ量や回数を監視し、不審な利用を可視化

一方で、カバーしきれないのは次のような領域です。

-

私物スマホ経由のモバイル回線利用

-

ローカルにインストールされた生成AIアプリ

-

端末ローカルのファイルコピーやスクリーンショット経由の持ち出し

ネットワーク越しの“見える通信”には非常に強い一方、端末ローカルや私物端末まで完璧には追いきれない、という前提で設計することが重要です。

シャドーIT対策ツール(IT資産管理やエンドポイント管理)で「誰が何を使っているか」を見える化

シャドーAIの半分は、「そもそも何がどこで動いているか分からない」状態から生まれます。ここを押さえるのがIT資産管理やエンドポイント管理です。

代表的な活用ポイントは次の通りです。

-

端末ごとのインストールアプリ一覧を自動収集

-

未承認の生成AIクライアントやブラウザ拡張機能を検知

-

外部ストレージやUSBメモリ利用状況のログ取得

営業用ノートPCだけ古いポリシーのまま放置され、そこからシャドーAI利用が広がるパターンは珍しくありません。誰の端末が、どのルールで管理されているかを一元管理しておくことが、ネットワーク制御より先に必要になるケースもあります。

Webフィルタリングやプロキシ・DLPを使うことで「どのAIへ何を漏らさないか」をコントロール

次に重要なのが、「どのAIに、何を出さないか」です。Webフィルタリングやプロキシ、DLPを組み合わせると、次のような制御が可能になります。

-

未承認AIサイトへのアクセス遮断

-

承認AIサイトでも、アップロード可能なファイル種別を制限

-

社名・顧客名・個人情報のパターンにマッチする通信をDLPでブロック

特にDLPは、“中身”を見て止められる点が強力です。

| 技術 | 見ているもの | 得意なコントロール例 |

|---|---|---|

| Webフィルタリング | URL/カテゴリ | AIサイト自体へのアクセス制限 |

| プロキシ | 通信経路/先 | 通信ルート強制、ログ取得 |

| DLP | データ内容 | 個人情報・機密ワードの送信ブロック |

AI活用を完全に止めるのではなく、「機密度の高い情報だけを自動的に引っかける」レベルまで持っていくと、現場のストレスも最小化できます。

ローカルAIや社内GPTを安全な代替案として用意する意味を解説

最後のピースが、ローカルAIや社内GPTといった“安全な抜け道”をあえて用意する発想です。禁止だけの環境では、従業員は外部の無料サービスへ必ず流れます。

ローカルAIや社内GPTを用意するメリットは、次の通りです。

-

入力データが組織内から出ない前提で設計できる

-

学習データやプロンプトテンプレートを業務専用に最適化できる

-

ログを一元的に蓄積し、「誰がどんな目的でAIを使ったか」を後から検証できる

実務では、「社外AIは禁止だが、この社内GPTと一部の承認クラウドAIだけはOK」と入口を絞るだけで、シャドーAIの発生率が大きく下がります。AIをゼロにするのではなく、正規ルートを魅力的にしておくことが、技術的対策を生かすうえで欠かせない視点です。私の視点で言いますと、ここを用意せずにCASBやDLPだけを強化しても、数カ月後には私物端末経由のシャドーAIが静かに増殖しているケースが多いと感じます。

AI禁止ではなく管理された解禁を!利用ポリシーとガバナンス体制の実践設計図

「全部禁止」か「野放し」か、その二択で悩んでいるうちはシャドーAIは止まらないままです。ポイントは、現場が使いやすく、かつ監査に耐えられるラインを“設計して見せる”ことにあります。

AI利用ポリシーで必ず盛り込むべき5つの軸(目的・対象業務・入力禁止情報・許可ツールや責任)

まずは紙1枚レベルでよいので、次の5軸を明文化します。

| 軸 | 決める内容のポイント |

|---|---|

| 利用目的 | 業務効率化か品質向上か、どの指標を改善したいかを明記 |

| 対象業務 | 営業資料作成、ブログ記事案、コードレビューなど、OKな業務を列挙 |

| 入力禁止情報 | 機密データ、個人情報、NDA対象情報、顧客固有のプロンプト内容を具体例付きで禁止 |

| 許可ツール | 承認済みサービスと、社内提供のローカルAIや社内GPTを一覧で提示 |

| 責任と手続き | 最終判断者、ログ監視の担当部門、違反時の対応フローを定義 |

特に入力禁止情報は、抽象的な「機密情報」では伝わりません。

-

顧客名と金額がセットの見積書

-

個人を特定できる問い合わせメール全文

-

未公開の新サービス仕様書

といった“そのままの文章”レベルで例示すると、従業員の判断精度が一気に上がります。

情報システムや法務・経営・現場がしっかり噛み合うAIガバナンス構築の秘訣

AIガバナンスを成功させる企業は、最初から「誰がどこまで口を出すか」を整理しています。

-

情報システム部門

- 承認ツール選定、アクセス制御、ログ取得を担当

-

法務・コンプライアンス部門

- 利用ガイドライン、NDAとの整合、違反時対応を設計

-

経営層

- AI活用の方向性とリスク許容度を明示

-

現場部門(営業・マーケ・開発など)

- 実際の利用シーンと必要な効率化ポイントを提示

これを週1の会議で延々議論するのではなく、90日単位の“トライアルと見直しサイクル”として回すのが現実的です。

- まずは2〜3部門で試験運用

- 利用ログとトラブル発生状況を情報システムがレポート

- 法務と現場でポリシーの言い回しを修正

- 経営層が対象部門拡大の可否を判断

私の視点で言いますと、ここで失敗する企業は「一度決めたルールを憲法のように固定」してしまい、現場が守れずシャドーAIが復活するパターンが多いです。ルールはプロダクトと同じく、バージョンアップ前提で扱う方がうまく回ります。

シャドーAIを減らすために効く従業員教育やリテラシー強化の現実的アプローチ

教育は「座学1回で終わり」にすると、ほぼ効果が出ません。鍵になるのは、短く・頻繁に・自分事として届けることです。

-

30分のキックオフ研修

- シャドーITや過去の情報漏洩事件を具体例で解説

- AI禁止ではなく管理された解禁にする理由を共有

-

月1回のマイクロラーニング

- 社内チャットで「今月のやってはいけない入力例」を配信

- ChatGPTや他サービスに誤って投げられそうなプロンプト例を提示

-

日常業務での“その場フィードバック”

- 承認ツール以外へのアクセスを検知したら、いきなりブロックだけでなく、理由と代替手段を情報システムから個別案内

教育施策と技術的制御をセットにすることで、従業員は「なぜブロックされたか」「どのサービスなら安全か」を体感しながら理解していきます。これは単なるセキュリティ対策ではなく、長期的にはコンテンツ品質やブランド価値を守り、生産性向上とリスク低減の両方を実現する土台になります。

規模別シャドーAI対策ツール導入ロードマップ中小からエンタープライズまで無理なく進めるステップ

「どこまでやれば十分なのか」が見えないままツール選定を始めると、コストも現場も一気に疲弊します。規模別に“これだけは外せないセット”を押さえる方が、結果的に早く安全に進みます。

従業員50名までの会社がまず押さえるガイドラインと簡単モニタリングセット

小規模組織でいきなりCASBに投資するのは、軽自動車に戦車砲を積むようなものです。まずは「人とルール+最低限の見える化」に集中します。

優先すべき3点セット

-

AI利用ガイドライン(入力禁止情報・利用目的・責任範囲)

-

ブラウザ履歴やプロキシログによる簡易モニタリング

-

許可した生成AIサービス一覧の共有(社内ポータルや資料)

小規模では、GoogleアカウントやMicrosoftアカウントでログインできる生成AIサービスが“勝手利用”の入り口になりがちです。

私の視点で言いますと、ここでは「禁止ワード集を作る」のが即効性の高い一手です。顧客名・個人情報・NDA対象語を列挙し、AIへの入力を明確にNGとします。

50〜300名規模で効力を発揮!IT資産管理とWebフィルタリングの最適タッグ

この規模になると、情シスや情報セキュリティ担当マネージャーが“どの端末で何が動いているか”を把握できなくなります。ここで鍵になるのがIT資産管理とWebフィルタリングの組み合わせです。

主なレイヤーを整理すると次の通りです。

| レイヤー | 目的 | 代表的な手段・製品イメージ |

|---|---|---|

| IT資産管理 | 端末とアプリの可視化 | LANSCOPEやMOTEX系ツールなど |

| Webフィルタリング | 生成AIサイトへのアクセス制御 | プロキシサービス、UTM機能 |

| ログ監視 | 誰がどこにアクセスしたかの把握 | Syslog集中管理、SIEMの軽量版 |

このタッグで重要なのは、「誰が」「どの端末から」「どのAIサービスに」アクセスしているかを連続して追える状態にすることです。

Webフィルタリングは「全面ブロック」ではなく、営業・マーケ用の許可サービスをホワイトリスト化し、他は段階的に制限する形が現実的です。

300名以上で本気導入に向くCASBやSSE・DLPのポイントと落とし穴を徹底解説

エンタープライズ領域では、クラウドサービスが爆発的に増え、シャドーITとシャドーAIが一体化してきます。ここでようやくCASBやSSE、DLPの出番です。

| 技術 | 得意分野 | 落とし穴 |

|---|---|---|

| CASB(ZscalerやNetskope等) | クラウドサービス利用の可視化と制御 | ポリシー設計が甘いとアラート洪水 |

| SSE | ゼロトラスト前提のWeb・アプリアクセス制御 | 既存ネットワークとの共存設計が難しい |

| DLP | 機密データの持ち出し検知・ブロック | 業務に必要な送信まで止めて現場反発 |

ここで避けたいのは、ツール先行導入で「誰もダッシュボードを見ない」状態になることです。運用体制を作らずにZscalerやNetskope、DLP製品を入れると、

-

アラート対応の担当不在

-

ポリシーチューニングが進まず誤検知だらけ

-

結局、“監査用ログ置き場”に成り下がる

という筋書きになりやすいです。

エンタープライズでは、まず部門単位でパイロット導入を行い、「AI利用ルール×CASBポリシー×DLPルール」をセットで設計してから全社展開に進めると、シャドーAIの抑止と業務効率の両立がしやすくなります。

よくある失敗パターン3選ツール入れすぎや“アラート地獄”を回避する打開策

シャドーなAI利用を抑えたいはずが、気付いたら「ツールまみれ」「誰も見ないダッシュボード」。この逆転現象を止めない限り、どれだけ投資しても現場のリスクは下がりません。ここでは、現場で本当に起きている失敗パターンと、すぐに修正できる打開策を絞り込んで解説します。

「とりあえずCASB導入」が運用崩壊するまでの落とし穴

CASBやZscaler、Netskopeを入れた瞬間から、シャドーなクラウド利用や生成AIサービスのアクセスログが一気に露出します。問題は、その量です。

よくある崩壊パターンは次の通りです。

-

アラート条件を細かく設計しないまま本番運用

-

「AIサービスは全部ブロック」で現場の反発と抜け道探しが加速

-

情報システム部門だけがアラート対応を抱え込み、1カ月で疲弊

打開策は、いきなり“本番ポリシー”を適用しないことです。

- 最初の1~2カ月は「監視オン・ブロック最小限」で、利用実態を把握

- 機密情報に近い部門(開発・経営企画・人事)だけ、厳しめのルールを先行適用

- 営業・マーケなどAI活用が売上に直結する部門は、「代替ツール提供+段階的制御」にする

これをやらずに一律ブロックすると、私物スマホや個人アカウント経由のシャドーITが一気に膨らみます。

AI利用ログを取ったのに“誰も見ない誰も判断しない”を防ぐ賢い手順

AI利用ログを収集するDLPやプロキシ、IT資産管理ツールを導入しても、「ログは山ほどあるのに、判断できる人がいない」という状態に陥りがちです。

まず押さえるべきは、“見るべきログ”を3階層に分けることです。

-

レベル1: 自動通知だけでよい情報(単純なアクセス数、利用時間など)

-

レベル2: 週次レビュー対象(特定部門での大量アップロード、深夜帯の利用)

-

レベル3: 即時エスカレーション(外部AIへの顧客データ送信、ソースコード大量貼り付けなど)

これを決めたうえで、役割分担をテーブルで固定しておくと、運用が一気に楽になります。

| ログレベル | 主担当部門 | 対応スピード | 代表的な判断内容 |

|---|---|---|---|

| レベル1 | 情報システム | 月次 | 利用傾向の把握とポリシー見直し候補抽出 |

| レベル2 | 情報システム+各部門マネージャー | 週次 | 業務に必要か、不適切かの線引き |

| レベル3 | 情報システム+法務+経営 | 当日 | インシデント扱いにするか、教育で済ませるかの判断 |

この「誰が・どのレベルのログを・どれくらいの頻度で見るか」が決まっていないと、ダッシュボードはすぐに“誰も見ない壁紙”になります。

ベンダー任せにせず社内に最低限必要な運用設計図を持つ方法

SIerやセキュリティベンダーは、ツールの機能には詳しくても、自社の業務プロセスや売上構造までは把握していません。

ここを情報システム側が渡さないまま丸投げすると、「機能としては正しいけれど、現場にはまったくフィットしない設定」になりがちです。

最低限、社内で用意しておくべき運用設計図は次の3点です。

-

どの業務でAI活用が売上や生産性に直結しているかを一覧化

-

入力禁止情報(機密情報、個人情報、NDA対象データ)の具体例リスト

-

インシデント発生時のエスカレーションフロー(誰にいつ連絡するか)

| 設計項目 | 目的 | ベンダーに共有するポイント |

|---|---|---|

| AI活用業務マップ | 不要なブロックを避ける | 部門別に「絶対止めたくない業務」を明示 |

| 入力禁止情報リスト | 情報漏洩リスクの明確化 | 実際の項目名やシステム名単位で共有 |

| エスカレーションフロー | 事故時の初動統一 | 連絡先・判断権限・記録方法を図で示す |

AI活用とWebマーケ支援の現場を見てきた私の視点で言いますと、この3点さえ社内で握れていれば、ツール選定もポリシー設計も格段にスムーズになります。

ツールを増やす前に、この“運用の下書き”を作ることが、シャドーな利用を減らしつつ現場のスピードを守る近道になります。

AI活用チーム成功と失敗の分かれ道 現場発シャドーAIとコンプライアンスのリアル

AI活用が進んでいる企業ほど、成果の裏側でシャドーAIとコンプライアンス違反の火種が静かに育ちます。表向きは「生産性が2倍になりました」と拍手喝采でも、水面下では「誰がどのAIに何を入れているか」が誰も把握していない、という状態が珍しくありません。

私の視点で言いますと、ここで運命を分けるのは「AIをどう位置付けるか」を最初に決めたかどうかです。

AIをたたき台利用にとどめるチームと最終成果物まで使ってしまうチームの明暗

AIをあくまでたたき台専用の“下書きマシン”として扱うチームと、AI出力をそのまま顧客提出物にしてしまうチームでは、数カ月後に次のような差が出ます。

| 観点 | たたき台利用チーム | 最終成果物までAI任せチーム |

|---|---|---|

| 機密情報の入力 | 匿名化・要約して入力 | 原文のままコピペ |

| 品質チェック | 人が必ずレビュー | 時間優先でほぼノーチェック |

| ログ管理 | 部門で利用履歴を共有 | 個々人がバラバラに利用 |

| トラブル時の説明責任 | 根拠を追跡しやすい | 「どのAIに何を聞いたか不明」 |

前者は、プロンプト段階で顧客名や個人情報をマスキングし、「AIが出した骨組みを人が磨く」流れを徹底します。結果として、情報漏洩リスクとブランド毀損リスクを同時に抑えながら、生産性だけを底上げできます。

一方で後者は、「急ぎなので、とりあえずAIに企画書を書かせて提出してしまう」といった運用になりがちです。NDA対象の資料をそのまま入力する、AIのハルシネーションを見抜けず誤情報を顧客へ出してしまうなど、コンプライアンス違反と信用失墜がセットで近づいてきます。

コンテンツ品質やブランド価値SEO評価に効くAI活用のコツ

Webマーケや営業支援の現場で成果が出ているチームは、AIに「書かせる」のではなく、人が判断しやすい素材を作らせる使い方に徹しています。ポイントは次の3つです。

-

構成案と見出しだけAIに作らせる

→ 検索意図の漏れを防ぎつつ、最終文章は人がブランドトーンに合わせて執筆します。

-

固有名詞と数値情報は必ず人が裏取りする

→ セキュリティリスクだけでなく、SEO評価に直結する「事実性」「専門性」を守れます。

-

プロンプトそのものを資産として管理する

→ 再現性の高いプロンプトをチームで共有すれば、属人化せず品質を揃えられます。

AI任せのコンテンツは、一見スムーズに量産できますが、同質化と信頼性低下で中長期の検索評価を落とすリスクがあります。逆に、AIは調査の整理や構造化に限定し、「語り口・事例・結論」はあくまで自社の頭で考えるチームほど、ブランドらしさとSEOの両方を守りやすくなります。

成功事例がなぜ別部署のシャドーAI増加の引き金にもなるのか?

もう1つ見落とされがちなポイントが、「成功事例がシャドーAIを増殖させるトリガーになる」という現象です。

ある部門でAIをきちんと管理して使い、売上やリード獲得が伸びたとします。この話が社内で共有されると、他部門の従業員は次のように動きがちです。

-

「うちもすぐ真似したいが、正式な承認やツール選定を待っていられない」

-

「情シスは忙しそうだから、まずは個人アカウントで試してみよう」

-

「プロンプトをコピーして、自分の案件データをそのまま流し込んでみよう」

ここでガイドラインやツールが追いついていないと、成功の噂だけが先行し、監視外のAI利用が一気に広がります。営業が持ち出しPCから外部サービスにアクセスする、マーケ担当が私物スマホのアプリで顧客データを扱う、といったシャドーITと一体化したシャドーAIが発生します。

これを防ぐには、成果が出たタイミングこそ、以下をセットで打ち出すことが重要です。

-

成功した部門の利用ルールとプロンプト例を社内標準として共有する

-

どのツールなら利用してよいか、承認済みサービス一覧を公開する

-

新たにAIを使いたい部門向けに、情シス・法務・経営が窓口となる相談フローを用意する

AI活用を社内に広げるフェーズは、単に「褒めて真似させる」だけでなく、統一ルールと監視のレールを同時に敷けるかどうかが勝負どころです。ここを押さえられれば、シャドーAIに振り回される組織から、AIを味方に付けた組織へと一段上のステージに進めます。

チェックリスト&FAQシャドーAI対策ツール導入前に絶対クリアすべきポイント総まとめ

「とりあえず禁止」「とりあえずツール導入」から卒業して、情シスと現場が同じ地図を見られる状態を作ることがスタートラインになります。ここだけは外せないチェックポイントを整理します。

「AIに入力してはいけない情報」はどこまで?現実的な線引きルール

まずは、現場が迷わず判断できる“3段階ルール”を決めます。

入力可否の実務ルール例

| 区分 | 具体例 | パブリックAI(ChatGPTなど) | 社内GPT・ローカルAI |

|---|---|---|---|

| レベル1 業務一般 | 公開中のブログ記事、製品概要 | 利用可 | 利用可 |

| レベル2 要配慮情報 | 社内ノウハウ、未公開提案の骨子 | 原則禁止 | 条件付き許可 |

| レベル3 機密・個人情報 | 顧客名簿、契約書全文、NDA対象 | 完全禁止 | 原則禁止 |

実務では、次の3つを“赤ライン”として明文化しておくと迷いが減ります。

-

顧客を特定できる個人情報

-

契約書・見積書・提案書の全文や原文コピー

-

自社や取引先の未公開数字(売上、原価、単価、アクセスログなど)

「一部なら大丈夫」という認識から漏洩が起きるので、「コピー&ペーストで丸ごと入れない」「固有名詞は必ずマスキングする」といったプロンプト単位のルールまで具体的に決めておくことが重要です。

シャドーITを防ぐならネットワークや端末・クラウドの「ここ」を押さえよう

AIだけを見ていると、私物スマホや個人アカウント経由の利用が抜け道になります。シャドーITとセットで押さえるべきポイントは次の通りです。

技術対策チェックリスト

-

ネットワーク

- 社内ネットワークからの生成AIアクセスを、プロキシやZscalerなどでログ取得

- 危険度の高いAIサービスはカテゴリ単位でブロック

-

端末・エンドポイント

- IT資産管理ツールで「未承認アプリ」「ブラウザ拡張機能」を可視化

- 私物PC・スマホからの業務システムアクセス可否を明確化

-

クラウドサービス

- CASBでクラウド上のAIサービス利用状況を把握

- ファイル共有サービスから外部AIへのアップロードをDLPで制御

技術的なブロックと同時に、「なぜそのAIが危険なのか」「承認済みの代替サービスは何か」を従業員にセットで伝えないと、別の抜け道が生まれやすくなります。

ベンダー選定で見落としがちな運用や監視体制チェック項目

多くの企業で問題になるのは“導入後3カ月で誰も画面を開かない”状態です。これを防ぐために、ベンダー選定時に必ず確認しておきたいのが次のポイントです。

運用・監視の事前チェック項目

-

アラート設計

- 初期テンプレートだけでなく、自社のポリシーに合わせたルール作成を支援してくれるか

- 「重大インシデント」と「要観察」をレベル分けできるか

-

ダッシュボード・レポート

- 経営層向けの要約レポートを自動出力できるか

- 部門別の利用状況やリスクスコアを一目で把握できるか

-

サポート体制

- 月次レビューや運用チューニングを一緒に行うサービスがあるか

- インシデント発生時の初動対応フローを事前に設計してくれるか

-

社内体制とのフィット

- 自社側でどの程度の人員・スキルが必要かを具体的に説明してくれるか

- 他社の情シス・マネージャーがどのように運用しているか、事例レベルで教えてくれるか

シャドーAI対策は「買って終わり」の世界ではありません。AI活用とWebマーケ支援に関わってきた私の視点で言いますと、ツールの機能差よりも、ポリシー設計と運用設計を一緒に描けるベンダーかどうかが、1年後の“効いているかどうか”を分ける最大のポイントになります。

Webマーケ現場から語る“賢いリスク管理” 宇井和朗流シャドーAI対策ツール成功術

AI業務効率化と情報漏洩やブランド毀損リスクの損益分岐点を読み解く

AIは、営業資料の作成時間を半分にしながら、同時に1回の誤入力で数年育てたブランドを吹き飛ばすこともあります。極端に聞こえますが、Webマーケ現場ではそれくらい「効率」と「リスク」がシーソーのように揺れています。

私の視点で言いますと、損益分岐点は次の2軸を超えた瞬間です。

| 観点 | 安全ゾーン | 危険ゾーン |

|---|---|---|

| 入力する情報 | 公開済み情報、架空データ | 顧客リスト、見積、契約書ドラフト |

| ログと可視化 | 誰が何を使ったか追える | 私物端末や未承認クラウドで痕跡なし |

ここで効いてくるのが、IT資産管理とWebフィルタリング、CASBやDLP、社内GPTといった複数レイヤーの組み合わせです。どれか1つのツールで守ろうとすると、コストに対して守備範囲が薄くなり、結果的に「禁止の割に抜け道だらけ」という最悪パターンに陥ります。

SEOやMEO・AIO支援現場で見えたAIコンテンツ運用の成功&失敗パターン

Web集客支援の現場で見てきたチームを整理すると、AIコンテンツ運用は次の3パターンに分かれます。

-

成功パターン

- AIは構成案やたたき台まで

- 最終チェックは専門担当が実施

- プロンプトに「入力禁止情報」が明文化されている

-

グレーゾーンパターン

- 量産はできているが、ブランドトーンが記事ごとにバラバラ

- SEO評価が一時的に伸びても、専門性の薄さで伸び悩む

-

失敗パターン

- 営業資料や提案書をそのままAIにコピペ

- 出力文をほぼ無加工で公開

- ログが残らず、問題発生時に誰も説明できない

失敗パターンの多くは、「ツールの是非」以前に、AI利用ガイドラインと監視体制が存在しないことが根っこにあります。シャドーIT対策の仕組みを流用し、誰がどの生成サービスにアクセスしているかだけでも可視化すると、リスクの高い使い方は一気に炙り出されます。

シャドーAI対策ツールを単なるコストでなくWeb集客や事業成長の基盤に変える思考

マーケ予算の視点で見ると、セキュリティ関連は「売上に直結しないコスト」に見えやすくなります。ですが、AI活用とセットで考えると、話がまったく変わります。

-

安全な社内GPTやローカルAIを用意

-

公開情報やナレッジを事前に学習させる

-

利用ログをマーケデータとして分析する

この流れを作ると、ツール群は「事故防止装置」から「業務データを集約するマーケ基盤」に変わります。どの部署がどのテーマでAIを使っているかが見えるので、コンテンツ企画やセールスイネーブルメントのヒントがそのままログから拾えるようになるからです。

ポイントは、セキュリティ担当だけで選定を完結させないことです。情報システムとマーケ、営業、法務が同じテーブルで「どこまで効率を上げ、どこでブレーキを踏むか」を決め、そのラインを守れるようにツールを組み合わせていくことが、中長期のWeb集客と事業成長を支える土台になります。

この記事を書いた理由

著者 – 宇井 和朗(株式会社アシスト 代表)

ここ数年、SEOやMEOの支援先で「生成AIを止めたい情報システム」と「AIを止められない現場」の板挟み相談が急激に増えました。アクセス制御だけ強化した結果、営業が自宅PCから無償AIに顧客リストを貼り付けてしまい、冷や汗をかきながら対処したケースもあります。別の会社では、高価なCASBとDLPを入れたのに、運用設計が甘くアラートだけが積み上がり、半年後には誰も画面を開かなくなっていました。

私自身、社内のWebマーケチームがAIを使い始めた際、最初は「禁止」で抑え込もうとして反発を生み、結果としてシャドーAI利用を増やしてしまった失敗があります。経営者としては売上を伸ばすためにAI活用を加速させたい。一方で、80,000社以上の支援を通じて、情報漏洩やブランド毀損が一度起きると、集客施策どころではなくなる現場も見てきました。

この記事では、単にツール名を並べるのではなく、「どの規模の会社が、どの順番で、どこまでツールに任せ、どこからをルールと教育で担保するか」を、私が経営と現場の両方で失敗と試行を重ねながら作ってきた考え方として整理しています。AI活用を諦めずに、会社とお客様を守る現実的な落としどころを、一緒に描いていければと思い執筆しました。